#1574: Veelgestelde vragen over Apples uitgebreide bescherming voor kinderen, bestuur beeldschermen van derden met Lunar, groepskaarten ondertekenen tijdens een pandemie

Apple veroorzaakte een storm van protest toen het bedrijf vorige week aankondigde dat foto's die worden geüpload naar iCloud-foto's gescand gaan worden om te zien of er bekende beelden van kindermisbruik bij zitten en dat afbeeldingen in de Berichten-app gecontroleerd worden op mogelijk gevoelig materiaal. Glenn Fleishman en Rich Mogull hebben een uitgebreide FAQ opgezet met meer informatie over hoe deze technologie werkt en hoe Apple tegemoet tracht te komen aan zorgen over privacy. Als je problemen hebt ondervonden met het instellen van de helderheid op een scherm van een andere fabrikant dat aangesloten is op een M1-Mac kunnen we je uitleggen waarom dat is. Nieuwe medewerker TJ Luoma recenseert Lunar, een gereedschap dat een technologie introduceert die ontbreekt op Macs met een M1-processor en die schermen van derden kan bedienen. Ten slotte wilde Adam Engst dat zijn hardloopgroep een kaart ondertekende voor een vriend die vertrok, maar hij vond het lastig om dit voor elkaar te krijgen tijdens de pandemie. Hij deelt zijn oplossing, zodat anderen van zijn zoektocht kunnen profiteren. De interessante Mac-app-updates van deze week zijn Quicken 6.3, Alfred 4.5, Ulysses 23.1 en Art Text 4.1. ![]()

- Een oplossing voor het maken van een certificaat met groepswensen ten tijde van een pandemie

- Totale verduistering van de Mac: Lunar stuurt beeldschermen van anderen

- Veelgestelde vragen over Apples uitgebreide bescherming voor kinderen

- Volglijst: Mac app-updates

- ExtraBITS

De Nederlandse editie van TidBITS is een letterlijke vertaling van de oorspronkelijke Engelse versie. Daarom is het mogelijk dat een deel van de inhoud niet geldt in bepaalde landen buiten de VS.

Dit nummer werd uit het Engels vertaald door:

• Dirk Paul Flach

• Henk Verhaar

• Paul Bánsági

• Thierry Kumps

• Joek Roex

• Peter Huizenga

• Nico Seine

• Elmar Düren

• Jos van den Berg

Verder werkten mee:

• Coördinatie: Renate Wesselingh

• Montage: Elmar Düren

• Eindredactie: Renate Wesselingh, Sander Lam & Elmar Düren

Hoe je ons kunt bereiken kun je lezen op <de contactpagina>

Een oplossing voor het maken van een certificaat met groepswensen ten tijde van een pandemie

[vertaling: HV]

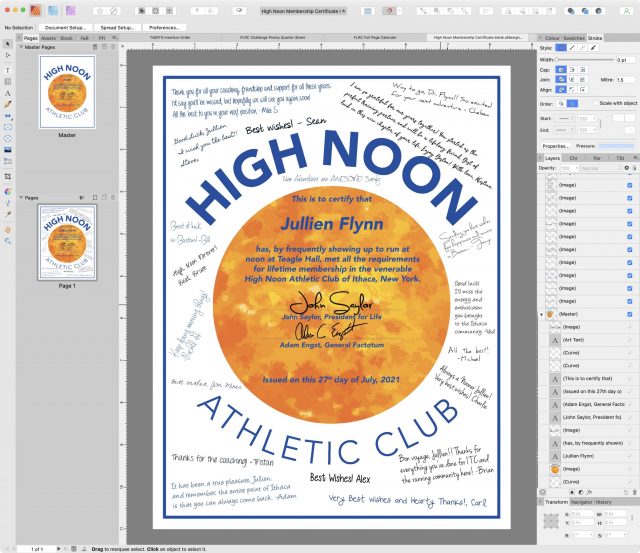

De 'High Noon Athletic Club' waar ik bij hardloop heeft een traditie - dat wil zeggen, die hadden we voordat de pandemie uitbrak. Om stil te staan bij het vertrek van één van de vaste leden wordt er altijd een 'laatste loop' georganiseerd, inclusief een drankje bij een plaatselijk riviertje en een certificaat van lidmaatschap dat van te voren stiekem rondgaat in de kleedkamers, waar de rest van de leden hun beste wensen aan kunnen toevertrouwen. Onlangs heeft één van onze leden haar Doctoraat behaald en zou daarmee vertrekken naar MIT voor een postdoc-aanstelling, maar omdat we nog steeds geen regelmatige lunchlopen houden was er geen mogelijkheid om handtekeningen te verzamelen.

We waren echter niet van plan om al weer een traditie ten prooi te laten vallen aan de pandemie en dus bedacht ik een plan, dat ik hier wil delen met eenieder die zich in een vergelijkbare situatie bevindt. Mijn oplossing moest wel aan een aantal voorwaarden voldoen:

- Mensen moesten de mogelijkheid hebben om een bericht geheel naar eigen inzicht te schrijven.

- De berichten op het certificaat van lidmaatschap moesten er handgeschreven uitzien, maar niet alsof ze allemaal door dezelfde persoon, en met dezelfde pen waren geschreven.

- En het moest geen urenlang opschoonwerk van gescande of gefotografeerde berichten vereisen.

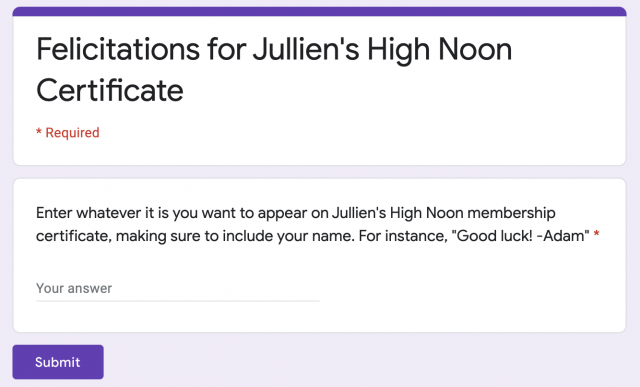

Voor het verzamelen van de berichten creëerde ik een Google Form met één enkele korte vraag; een koppeling naar dit formulier stuurde ik naar de verzendlijst van de club. Ik vroeg aan de leden om hun berichten kort te houden, hoewel ik niet verbaasd was dat sommige leden toch flink uitweidden.

Veel mensen beseffen niet dat Google Forms antwoorden kan bewaren in een Google Sheet, waardoor het eenvoudig is om naderhand met deze antwoorden aan de slag te gaan. Daarmee had ik de gegevens die ik nodig had, in een formaat van waaruit het eenvoudig kopiëren en plakken was.

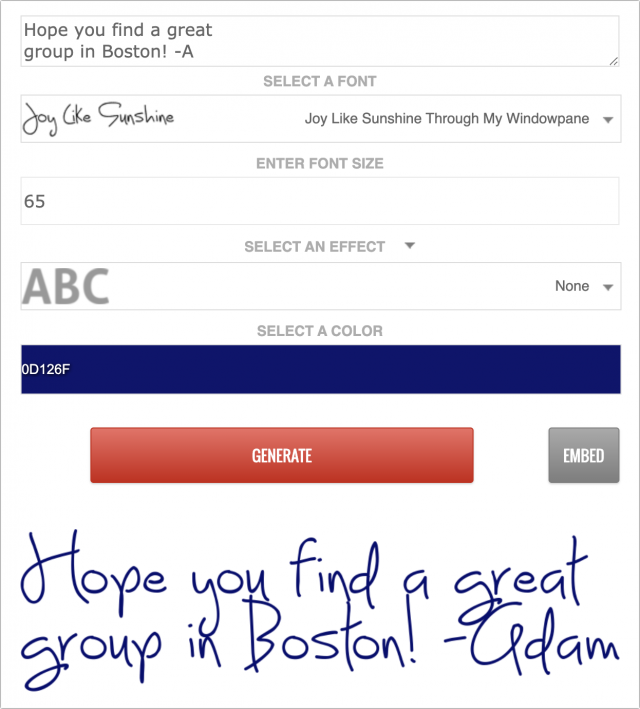

Een sleutelrol in het project was weggelegd voor Font Memes' Text Graphic Generator for Handwriting Fonts. Hiermee kon ik een stuk tekst selecteren, een keuze maken uit een grote variëteit aan handgeschreven lettertypen, alsmede een aantal kleuren. De tekst werd vervolgens omgezet in een PNG afbeelding. Als ik tevreden was met het resultaat kon ik de afbeelding eenvoudig control-klikken en "Copy Image" kiezen.

Vervolgens opende ik het certificaat van lidmaatschap in Affinity Publisher. (Ik ben al mijn projecten aan het converteren van Adobe InDesign en Adobe Illustrator naar Affinity Publisher en Affinity Designer omdat ze allebei niet duurder zijn dan één maand Adobe Creative Cloud abonnementskosten). Ik plakte de berichten in het certificaat, maakte ze op maat voor een open ruimte, en zette ze onder een willekeurige hoek, alsof iemand een bericht in een lege ruimte had proberen te proppen. Zo voegde ik successievelijk alle berichten aan het certificaat toe, elk in zijn eigen lettertype. Aan sommige berichten moest ik wat harde returns toevoegen, om ze beter passend te maken, en ik maakte sommigen blauw in plaats van zwart, alsof ze met verschillende pennen geschreven waren. Vervolgens maakte ik het op maat en voegde het in, zodanig dat het geheel realistisch overkwam. Dat kostte wel wat tijd maar het eindresultaat was beter dan verwacht en een stuk netter (en met minder zweetvlekken) dan onze 'normale' certificaten.

Dit projectje is uiteraard geen panacee maar het was toch bevredigend om een aantal dagelijkse gereedschappen in te kunnen zetten om iets aardigs te doen voor een goeie kennis die afscheid neemt. Ik hoop dat anderen hier ook iets aan hebben.

Totale verduistering van de Mac: Lunar stuurt beeldschermen van anderen

[vertaling: PAB, HV]

Niet lang nadat ik mijn M1-Mac mini had ontvangen, was ik 's avonds laat aan het werk en besloot ik de helderheid van mijn Dell-monitor te verlagen. Ik reikte omhoog en drukte op de F1-toets van mijn Magic Keyboard, zoals ik al zo lang had gedaan als ik me kon herinneren. Er gebeurde niets. Ik probeerde het opnieuw, maar het mocht niet baten.

De afgelopen jaren heb ik een aantal MacBooks gebruikt: een 12-inch MacBook, een MacBook Air en een 16-inch MacBook Pro. Dit was de eerste keer dat ik een Mac mini met een extern beeldscherm als mijn primaire computer gebruikte. Ik ging ervan uit dat ik de helderheid van mijn beeldscherm kon regelen met de standaardtoetsen op het toetsenbord van een Mac of met de schuifregelaar voor de helderheid in ‘Systeemvoorkeuren > Beeldschermen’.

Ik had het mis. Het blijkt dat Macs niet per se de helderheid kunnen regelen op externe beeldschermen met ingebouwde opties. Dat is natuurlijk geen probleem met Apple-beeldschermen zoals de oudere Thunderbolt Display, de waanzinnig dure Pro Display XDR van tegenwoordig of de door Apple goedgekeurde LG UltraFine-beeldschermen.

Om redenen die ik niet begrijp, ontbreekt het macOS aan ingebouwde ondersteuning voor deze instellingen bij gebruik van een beeldscherm van een derde partij, afgezien van de paar modellen die hierboven zijn genoemd. Bezitters van Intel-Macs kunnen echter verschillende command-line en grafische tools voor dit doel gebruiken, maar geen enkele leek te werken op mijn M1-Mac mini. Ik begon dieper te graven en realiseerde me dat ik niet de enige was: bij elk van deze tools was er wel iemand die opmerkte dat het niet werkte met M1-Macs en dat het niet een probleem was dat Rosetta kon oplossen.

De reden lijkt te zijn dat M1-Macs geen ondersteuning hebben voor DDC of Display Data Channel, een standaard set van besturingsprotocollen die beeldschermen al vele jaren gebruiken. Elk programma dat ik kon vinden had DDC ondersteuning nodig en daarom werkte geen enkel op M1-Macs.

Ik zou natuurlijk de knoppen van mijn Dell-monitor kunnen gebruiken, als een beest, maar zoals iedereen weet: die zijn vreselijk. Mijn monitor heeft vier knoppen aan de onderkant, maar die passen de helderheid of het contrast niet aan. Dat zou te gemakkelijk zijn. Om die instellingen te regelen, moet ik door de menuhiërarchie op het scherm van het beeldscherm navigeren, waarvoor ik op een van de knoppen moet drukken, met een andere knop naar het juiste submenu omhoog of omlaag moet gaan, op een derde knop moet drukken om de helderheid te selecteren, en terug moet gaan naar een vorige knop om de helderheid omhoog of omlaag bij te stellen. Het gaat langzaam, het is onhandig, en ik druk altijd op de verkeerde knoppen en voel me uiteindelijk een idioot. Uiteindelijk vond ik een programma waarmee ik de helderheid en het contrast rechtstreeks vanaf mijn M1-gebaseerde Mac mini kon regelen.

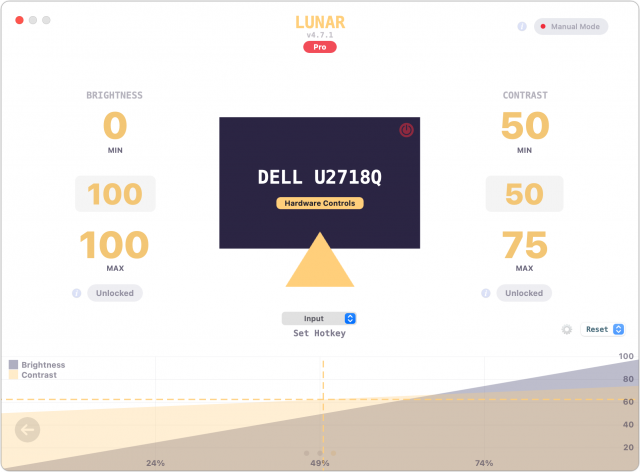

Lunar, ontwikkeld door Alin Panaitiu, heeft een gestage ontwikkelingsstroom gehad die culmineerde in de officiële publicatie aan het eind van mei 2021. De website toonde een overvloed aan opties, waaronder een breed scala aan aanpasbare sneltoetsen. Nog cooler: het kan de helderheid automatisch regelen op basis van je locatie en de helderheid van een extern beeldscherm synchroniseren met het ingebouwde beeldscherm van een MacBook. Het belangrijkste is dat het gewoon werkt, en dat het betrouwbaar werkt.

Indertijd maakte Lunar gebruik van een indrukwekkende hack voor degenen onder ons die een op M1-Mac wilden gebruiken. Voor dergelijke Macs vertrouwde Lunar's beste hardwarematige oplossing op een Raspberry Pi om commando's van een Mac door te geven aan de externe HDMI-monitor. Aangezien de Raspberry Pi DDC ondersteunde, was dit bijna net zo goed als een native oplossing... als je een Raspberry Pi had. Dat had ik, en ik stelde deze "netwerkbesturing" in, wat bijzonxder eenvoudig was: ik voerde mijn Raspberry Pi gebruikersnaam en wachtwoord in en koos vervolgens een menu-optie van Lunar. (Lunar heeft ook een softwarematige oplossing die vertrouwt op het aanpassen van gammawaarden maar dat conflicteerde met hulpprogramma's zoals f.lux die ook gamma gebruiken, alleen de helderheid konden verlagen en niet verhogen en andere monitorbedieningen voor volume en invoer misten).

Maar Panaitiu heeft het daar niet bij gelaten. Met wat hulp van andere ontwikkelaars die hebben bijgedragen aan het project, heeft hij onlangs native DDC-ondersteuning voor M1-Macs toegevoegd aan Lunar 4.5.1, dus er is geen noodzaak voor een Raspberry Pi of een softwarematige oplossing. Je kan nog steeds tegen problemen aanlopen als gevolg van bugs in de monitorfirmware, maar Lunar's FAQ legt veel van die problemen uit. (En als je echt geïnteresseerd bent in de achtergrond en technische details, zie Panaitiu's blog-post over hoe het krijgen van een M1-Mac hem ertoe bracht zijn baan op te zeggen en zich te richten op Lunar).

Nu kan ik mijn Dell-beeldscherm direkt vanaf mijn M1-Mac mini beheren, inclusief het beeld dat verschijnt als je instellingen wijzigt. Daarvoor moet ik wel een van de Thunderbolt-poorten gebruiken in plaats van de HDMI poort van de Mac mini (de combinatie van de HDMI poort en de videodriver van de Mac mini ondersteunt om de een of andere reden geen DDC berichten) maar ik kan de normale macOS-toetsen gebruiken voor het wijzigen van helderheid en contrast; ik kan ook de voorkeuren van Lunar gebruiken om eigen sneltoetsen te definiëren.

En jij kunt dat ook, mits je macOS 10.15 Catalina of recenter draait. Lunar is gratis, maar sommige geavanceerde functies vereisen een Pro licentie, die 23 dollar kost. Ik vond het geen probleem om dit project te ondersteunen. Uiteraard zouden we in een volmaakte wereld geen programmatuur van derden nodig moeten hebben om ondersteuning te krijgen voor protocollen die Apple zelf zou moeten bieden maar voor het moment is 23 dollar zeker niet te veel om een actieve en creatieve ontwikkelaar van ganser harte te ondersteunen. Daar komt bij dat TidBITS-leden nog eens 30% korting krijgen, waarmee de prijs zakt tot $ 16,10; dat maakt de beslissing des te eenvoudiger.

TJ Luoma is a Presbyteriaanse geestelijke en computernerd uit Plattsburgh, New York. Zijn eerste Mac was een NeXTStation die hij op de universiteit gebruikte, ergens in de vroege jaren 90, en eind jaren 90 was hij actief bij het draaien van de PEAK FTP-site voor NeXTStep/OpenStep software. Korter geleden heeft hij geschreven voor TUAW en MacStories en hij is te gast geweest in de Mac Power Users and Automators podcasts. Je vindt hem op Twitter als @tjluoma of op zijn website RhymesWithDiploma.com.

Veelgestelde vragen over Apples uitgebreide bescherming voor kinderen

[vertaling: TK, JR, DPF, PH, NS, LmR, DPF]

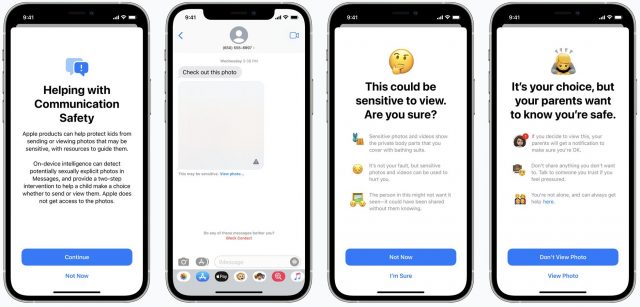

Twee privacywijzigingen die Apple wil doorvoeren om kinderen beter te beschermen, zullen worden uitgerold naar iCloud-foto's en Berichten in de iOS 15, iPadOS 15 en macOS 12 Monterey-versies in de Verenigde Staten.

De eerste heeft betrekking op het verhinderen van de overdracht en het bezit van foto's waarop seksueel misbruik van minderjarige kinderen te zien is, formeel bekend onder de term Child Sexual Abuse Material (CSAM) en meer algemeen "kinderpornografie" genoemd. (Aangezien kinderen niet kunnen instemmen, is pornografie een ongepaste term om te gebruiken, behalve in bepaalde juridische contexten). Voordat foto's vanaf een iPhone of iPad naar iCloud-foto's worden gesynchroniseerd, vergelijkt Apple ze met een lokale cryptografisch versluierde database van bekende CSAM.

De tweede biedt ouders de optie om op het apparaat een op machine-learning gebaseerde analyse van alle inkomende en uitgaande beelden in Berichten mogelijk te maken om te bepalen welke beelden seksueel van aard lijken. Deze optie vereist Gezinsdeling en is van toepassing op kinderen onder de 18. Als deze optie is ingeschakeld, krijgen kinderen een waarschuwing over de aard van de afbeelding en moeten ze tikken of klikken om de afbeelding te bekijken of te verzenden. Ouders van kinderen onder de 13 kunnen er bovendien voor kiezen om een waarschuwing te krijgen als hun kind "gevoelige" afbeeldingen verstuurt of ontvangt.

Apple zal ook Siri en Search bijwerken om onveilige situaties te herkennen, contextuele informatie te geven en in te grijpen als gebruikers zoeken naar CSAM-gerelateerde onderwerpen.

Zoals altijd het geval is met privacy en Apple, zijn deze veranderingen ingewikkeld en genuanceerd. De afgelopen paar jaar heeft Apple benadrukt dat onze privégegevens veilig onder onze controle moeten blijven, of het nu gaat om berichten, foto's of andere gegevens. Sterke versleuteling op apparaten en sterke end-to-end-versleuteling voor het verzenden en ontvangen van gegevens hebben zowel grootschalige privacyschendingen als de meer toevallige inbreuken voor reclamedoeleinden op wat we doen, zeggen en zien voorkomen.

Apples aankondiging kopte deze veranderingen als "Uitgebreide bescherming voor kinderen". Dat mag zo zijn, maar je zou ook kunnen zeggen dat de stap van Apple hun algehele privacypositie in gevaar brengt, ondanks de inspanningen die het bedrijf zich in het verleden heeft getroost om beveiligingen in te bouwen, ouders een leeftijdsadequaat inzicht te geven over jongere kinderen, en regeringen af te wijzen die wilden dat Apple zijn end-to-end-encryptie zou breken en iCloud minder privé zou maken om criminelen op te sporen (zie “FBI ontsleutelt de iPhone van de Pensacola-schutter en is nog steeds kwaad op Apple”, 19 mei 2020).

Je hebt wellicht veel vragen. Wij in ieder geval wel. Op basis van onze ervaring en de informatie die Apple openbaar heeft gemaakt, zijn hier antwoorden op sommige van wat wij denken dat de meest voorkomende zullen zijn. Na een storm van verwarring en klachten heeft Apple ook zijn eigen Expanded Protections for Children FAQ vrijgegeven, die grotendeels onze analyse en speculaties bevestigt.

Vraag: Waarom kondigt Apple deze technologieën nu aan?

Antwoord: Dat is de hamvraag. Hoewel dit nu alleen in de Verenigde Staten wordt uitgerold, is onze beste gok dat het bedrijf onder druk is gezet door regeringen en wetshandhavingsinstanties wereldwijd om meer deel te nemen aan door de overheid geleide inspanningen om kinderen te beschermen.

Naar verluidt zou Apple, dat verre van het eerste bedrijf dat dergelijke maatregelen neemt, een van de laatste grote techbedrijven zijn die dit doet. Andere grote bedrijven bewaren meer gegevens in de cloud, waar ze alleen worden beschermd door de encryptiesleutels van het bedrijf, waardoor ze gemakkelijker toegankelijk zijn voor analyse en gerechtelijke bevelen. Ook de technische inspanning achter deze technologieën heeft ongetwijfeld jaren geduurd en vele miljoenen dollars gekost, dus Apples motivatie moet aanzienlijk zijn geweest.

Het probleem is dat uitbuiting van kinderen op twee verschillende manieren een zeer asymmetrisch probleem is. Ten eerste is een relatief klein aantal mensen betrokken bij een vrij massale hoeveelheid CSAM-handel en directe online predatie. De FBI meldt in een overzicht van misbruik van CSAM dat er enkele honderdduizenden deelnemers zijn geïdentificeerd in de bekendste peer-to-peer handelsnetwerken. Dat is slechts een deel van het totaal, maar wel een aanzienlijk aantal. Het Crimes Against Children Research Center van de Universiteit van New Hampshire vond in haar onderzoek dat "1 op de 25 jongeren in een jaar een online seksueel verzoek kreeg waarbij de verzoeker offline contact probeerde te maken". Het internet is een zegen voor roofdieren.

De andere vorm van asymmetrie is de erkenning van het probleem door volwassenen. De meeste volwassenen zijn zich ervan bewust dat uitbuiting voorkomt - zowel door de verspreiding van beelden als door rechtstreeks contact - maar slechts weinigen hebben er zelf ervaring mee of zijn er zelf aan blootgesteld geweest, of via hun kinderen of familie. Dat leidt ertoe dat sommigen de situatie enigszins abstract en academisch bekijken. Degenen die dichter bij het probleem staan - persoonlijk of beroepsmatig - kunnen het zien als een verschrikking die moet worden uitgeroeid, ongeacht de middelen. Iemands persoonlijke mening over hoe ver techbedrijven kunnen en moeten gaan om uitbuiting van kinderen te voorkomen, hangt waarschijnlijk af van waar hij of zij staat op dat spectrum van ervaringen.

CSAM-detectie

V: Hoe kan Apple CSAM in iCloud-foto’s herkennen?

A: Het mag duidelijk zijn dat je geen raadpleegbare CSAM-database kunt bouwen, omdat deze lekgevoelig zou kunnen zijn en daardoor de kinderen opnieuw in een slachtofferrol zou plaatsen. Systemen die CSAM kunnen checken zijn afhankelijk van geabstraheerde vingerafdrukken van afbeeldingen die door de National Center for Missing and Exploited Children (NCMEC) zijn gescreend en samengesteld. Het NCMEC is een non-profitorganisatie met een semi-overheidsrol, die de groep toestaat om met materiaal te werken dat anders als illegaal bezit beschouwd zou worden. De organisatie is betrokken bij het volgen en identificeren van nieuw-gecreëerde CSAM, het achterhalen van de kinderen die erin afgebeeld zijn en het beëindigen van de handel in bestaande afbeeldingen. (De technologie heeft alleen betrekking op afbeeldingen, niet op video’s.)

Apple beschrijft het proces van het herkennen van CSAM in een witboek. De methode biedt het bedrijf de mogelijkheid om de NCMEC-database van cryptografisch gegenereerde vingerafdrukken (of hashes) op elke iPhone of iPad te bewaren. (Apple heeft niet bekend gemaakt hoe groot de database is; we hopen maar dat zij niet een significant percentage van het apparaatgeheugen in beslag gaat nemen.) Als een apparaat afbeeldingen wil synchroniseren met iCloud-foto’s, dan genereert Apple hashes via een algoritme dat NeuralHash heet, en dat een gecompliceerde set kenmerken aan een afbeelding onttrekt. Deze aanpak maakt het mogelijk om een “fuzzy match” met de NCMEC-vingerafdrukken te krijgen, in plaats van exacte, pixel-voor-pixel matchpunten – een exacte match kan namelijk gemanipuleerd worden door het formaat, de grootte of de kleur van een afbeelding te veranderen. Howard Oakley geeft een technischere uitleg van hoe het werkt.

Apple voert nog een aantal cryptografische veranderingen aan de hashes door, wat resulteert in een geheim dat diep in de servers van Apple verborgen blijft. Hierdoor wordt het praktisch onmogelijk om ook maar iets te leren over de hashes of afbeeldingen in de database die op onze apparaten bewaard zullen worden.

Q: Wat is het verband tussen CSAM-detectie en iCloud-foto's?

A: We vergeven je als je je nu afvraagt wat dit systeem nu eigenlijk van doen heeft met iCloud-foto's. Eigenlijk niets - of niet direct. Apple zegt dat het bedrijf alleen scant op CSAM-matches op je iPhone en iPad in geval bestanden staan te wachten om met iCloud-foto's gesynchroniseerd te worden. Een tweede deel van de operatie gebeurt echter in de cloud, afhankelijk van wat er geüpload is, zoals hierna beschreven wordt.

Afbeeldingen die al in je iCloud-accounts staan die eerder gesynchroniseerd werden naar iCloud-foto's, worden niet gescand. Er is echter niets wat het systeem ervan zou weerhouden om alle afbeeldingen op een apparaat te gaan scannen. En het is Apple ook niet verboden om later nog zo'n systeem bouwen om afbeeldingen in de cloud te controleren. Zoals Ben Thompson van Stratechery opmerkte is dit het verschil tussen mogelijkheid (Apple kan niet scannen) en beleid (Apple gaat niet scannen).

Misschien scant Apple op dit moment al bestanden in de cloud. Technisch columnist Jason Aten van Inc. magazine zei dat de persoon die bij Apple verantwoordelijk is voor privacy, Jane Horvath, in een 2020 CES-panel al zei dat Apple “aan deze mogelijkheid werkt”. MacRumors besteedde ook aandacht aan haar opmerkingen in dat panel: “Horvath bevestigde ook dat Apple scant op kinderporno bij afbeeldingen die naar iCloud geüpload worden. 'We gebruiken hiervoor een aantal technologieën,' zei ze." Apple maakte niet openbaar hoe, toen niet en nu niet, en het bedrijf is ook niet tot de orde geroepen door voorvechters van online privacy.

In het rapport van 2020 van NCMEC (een lijst met meldingen van providers) wordt gesteld dat Apple maar 265 meldingen uploadde naar het CyberTipline-systeem (wel meer dan de 205 van 2019). Dat is weinig vergeleken met de 20.307.216 van Facebook, 546.704 van Google en 96.776 van Microsoft. Apple is wettelijk verplicht om melding te maken, dus als er in iCloud-foto's gescand zou worden, zou het aantal veel hoger moeten zijn.

Q. Hoe houdt Apple rekening met privacy bij het scannen van afbeeldingen?

A: Alle afbeeldingen die klaarstaan voor upload naar iCloud-foto's worden gescand, maar het matchen (onder de naam private set intersection) gebeurt pas later. Dit betekent dat de eigenaar van een apparaat niet weet dat er een match is gevonden, en Apple kan dat pas later bepalen - en alleen dan als er meerdere matches zijn. Deze methode voorkomt ook dat iemand een iPhone of iPad gebruikt om te testen of een afbeelding een match is in de database.

Na het scannen genereert het systeem een zogeheten safety voucher, die bestaat uit een unieke code voor de afbeelding en een een versie van de afbeelding met lage resolutie. Dit wordt voor iedere afbeelding gedaan, zodat niemand (de gebruiker niet, Apple niet, de overheid niet, een hacker niet, enzovoort) de afwezigheid van zo'n voucher kan zien als een aanwijzig. Verder worden uploads ook voorzien van zogenaamde fout-positieve matches, zodat zelfs Apple niet weet hoeveel matches er zijn.

Apple beweert dat het deze safety vouchers zelf niet kan ontsleutelen, tenzij het specifieke iCloud-foto's-account een bepaalde drempel overschrijdt voor het aantal CSAM-objecten. Deze threshold secret sharing-technologie moet gebruikers geruststellen dat hun afbeeldingen privé blijven tenzij ze echt actief CSAM verspreiden.

Apple maakt gebruik van twee lagen van versleuteling in deze safety vouchers. De buitenste laag haalt de cryptografische informatie uit de NeuralHash van de afbeelding, die op het apparaat zelf wordt aangemaakt. Voor de binnenste laag verdeelt Apple feitelijk een sleutel op het apparaat in een aantal stukken. Ieder voucher bevat hier een onderdeel van. Om de safety vouchers te kunnen ontsleutelen moet een niet bekend gemaakt aantal afbeeldingen overeen komen met een bepaalde CSAM-vingerafdruk. Je zou bijvoorbeeld 10 van de 1000 stukken van de sleutel nodig kunnen hebben om de vouchers te kunnen ontsleutelen. (Technisch gesproken zouden we de term 'secret' (geheim) moeten gebruiken in plaats van 'key' (sleutel), maar het is gemakkelijker om aan een sleutel te denken.)

Met deze tweelaagse aanpak kan Apple alleen controleren of vouchers matches hebben zonder de afbeeldingen in de vouchers te kunnen bekijken. Pas als de servers van Apple hebben vastgesteld dat een drempel van een aantal vouchers met matches is overschreden, kan het geheim opnieuw worden samengesteld en kunnen de overeenkomende voorvertoningen met een lage resolutie worden opgehaald. (De drempel is ingesteld in het ontwerp van het systeem. Hoewel Apple deze later zou kunnen wijzigen, zou dat betekenen dat alle afbeeldingen opnieuw moeten worden berekend volgens de nieuwe drempel.)

Het gebruik van een drempel van een bepaald aantal afbeeldingen verkleint de kans op een enkele fout-positieve match met ernstige gevolgen. Zelfs als het percentage fout-positieven bijvoorbeeld zo hoog zou zijn als 0,01%, zou het vereisen van een overeenkomst van 10 afbeeldingen de kans op een algemeen fout-positief resultaat bijna elimineren. Apple schrijft in zijn witboek: "De drempel is geselecteerd om eenextreem lage kans (1 op 1 biljoen) te hebben om een bepaalde account ten onrechte aan te merken." Er zijn ook extra menselijke controles nadat een account is gemarkeerd.

Onze apparaten verzenden ook door apparatuur gegenereerde nep-matches. Aangezien die nep-matches een nepsleutel gebruiken, kan Apple de buitenste envelop decoderen, maar niet de binnenste. Deze benadering betekent dat Apple nooit het precieze aantal matches weet totdat de sleutels allemaal op één lijn liggen en het de binnenste enveloppen kan decoderen.

V: Staat Apple externe tests toe of hun systeem doet wat het zegt?

A: Apple beheert dit systeem volledig en het lijkt onwaarschijnlijk dat het een externe audit toelaat, of meer transparantie geeft over hoe het werkt. Deze houding zou in overeenstemming zijn met het niet toestaan om kwaadwilligen meer inzicht te geven hoe ze het systeem kunnen verslaan, maar dit betekent ook dat alleen Apple garanties kan bieden.

Apple heeft op zijn webpagina over de kinderbeschermingsinitiatieven een koppeling geplaatst naar witboeken van drie onderzoekers die vooraf waren geïnformeerd (zie "Meer informatie" onderaan de pagina). Twee van de onderzoekers vermelden niet of ze toegang hadden tot de programmacode of meer dan een beschrijving van het systeem kregen zoals gegeven in het Witboek van Apple.

Een derde, David Forsyth, schreef in zijn witboek: "Apple heeft me een hoeveelheid experimenteel en conceptueel materiaal laten zien met betrekking tot de praktische prestaties van dit systeem en heeft het systeem in detail beschreven." Dat is niet het soort externe strengheid dat zo'n cryptografisch en privacysysteem verdient.

Uiteindelijk, zelfs al zouden we het graag anders willen zien, heeft Apple zelden of nooit zelfs maar de meest persoonlijke blikken op een van zijn systemen aangeboden aan externe auditors of experts. We moeten hier niet anders verwachten.

V: Hoe beïnvloedt CSAM-scannen van iCloud-foto's mijn privacy?

A: Nogmaals, Apple zegt dat het met deze technologie geen afbeeldingen scant die al in iCloud-foto's zijn opgeslagen. Het lijkt erop dat het bedrijf deze ook niet al aan het scannen was. In plaats daarvan zegt deze aankondiging dat het bedrijf beeldcontroles op het apparaat zal uitvoeren van foto's die worden gesynchroniseerd met iCloud-foto's. Apple zegt dat het niet op de hoogte wordt gebracht van specifieke overeenkomsten totdat een bepaald aantal overeenkomsten is opgetreden in alle afbeeldingen die door een account zijn geüpload. Alleen wanneer die drempel wordt overschreden, kan Apple toegang krijgen tot de overeenkomende afbeeldingen en deze bekijken. Als de afbeeldingen inderdaad identiek zijn aan overeenkomende CSAM, zal Apple het account van de gebruiker blokkeren en rapporteren aan NCMEC, dat coördineert met de wetshandhaving voor de volgende stappen.

Het is het vermelden waard dat de online opslag van iCloud-Foto's op een lager beveiligingsniveau werkt dan Berichten. Waar Berichten end-to-end-encryptie gebruikt en de benodigde encryptiesleutels alleen beschikbaar zijn voor je apparaten en verborgen voor Apple, worden iCloud-Foto's gesynchroniseerd via beveiligde verbindingen, maar ze worden op zo'n manier opgeslagen dat Apple ze wel kan bekijken en analyseren. Dit ontwerp betekent dat wetshandhavers Apple wettelijk kunnen dwingen afbeeldingen te delen, wat in het verleden is gebeurd. Apple belooft om iCloud-gegevens, inclusief foto's en video's, privé te houden, maar kan de toegang technisch niet verhinderen zoals bij Berichten.

V: Wanneer zal Apple de gebruikers rapporteren aan de NCMEC?

A: Apple zegt dat er meerdere beelden moeten matchen voordat de cryptografische drempel wordt gepasseerd die nodig is om een intern alarm af kunnen geven. Hierna zullen mensen de matches bekijken (Apple geeft dit aan als “handmatig”) voordat het wordt gerapporteerd aan de NCMEC.

Er is ook een procedure om beroep aan te tekenen, hoewel Apple alleen maar zegt: “Als een gebruiker vindt dat diens account door een fout is gemarkeerd, kan een verzoek voor het herstellen van het account worden gedaan”. Het verlies van een toegang tot het iCloud-account is natuurlijk van minder zorgen dan te worden gerapporteerd aan de NCMEC en de rechtelijke macht.

(Heb wat sympathie voor de arme sukkels die de “handmatige” werk moeten verrichten voor het opsporen van mogelijk CSAM. Het is een verschrikkelijke taak en veel bedrijven besteden het werk uit aan contractanten die weinig bescherming hebben en bijvoorbeeld zelfs PTSS kunnen ontwikkelen. Wij hebben hoge verwachtingen dat Apple dit beter zal doen. Door een hoog detectieniveau in te stellen, wat Apple zegt te gaan doen, zullen veel minder handmatige evaluaties nodig zijn.)

V: Kan Apple de criteria wijzigen en op meer dan alleen CSAM scannen?

A: Absoluut. Of het bedrijf het zal doen is een andere vraag. De Electronic Frontier Foundation zegt het heel bot:

…het is niet mogelijk een scansysteem aan de clientzijde te maken dat alleen maar gebruikt wordt voor seksueel expliciete afbeeldingen die worden verstuurd of ontvangen door kinderen. Dientengevolge zal iedere poging, zelfs met de beste bedoelingen, om een dergelijk systeem te maken essentiële beloften van de versleuteling schenden en de deur openzetten voor verder misbruik.

Er is in het hele systeem geen enkele transparantie. Dat is specifiek gedaan om misbruikte kinderen niet nog verder het slachtoffer te laten zijn. Politici en kinderraadslieden hebben de neiging om eventuele zorgen dat pogingen om CSAM op te sporen en degenen die het ontvangen of verspreiden te identificeren, grootschalige gevolgen kan hebben voor de privacy, weg te wuiven.

Apples privacy-hoofd, Erik Neuenschwander, zei tegen de New York Times "Als je een hoeveelheid CSAM-materiaal opslaat pakt het inderdaad niet goed voor jou uit, maar voor ieder ander maakt het geen verschil”

Gezien het feit dat slechts een kleine groep mensen CSAM-afbeeldingen verstuurt of downloadt (en alleen de zeer dommen een cloud-dienst zouden gebruiken; de meesten gebruiken peer-to-peer netwerken op het zogenaamde "dark web") is dit een misleidende opmerking, vergelijkbaar met zeggen dat “als je geen gestolen goed bezit dan zou je blij moeten zijn met een Apple-camera in je huis waarmee wij kunnen bewijzen dat alles inderdaad van jou is”. De afweging van privacy en burgerrechten tegenover de bescherming van kinderen tegen verdere uitbuiting is een ingewikkelde balanceer-oefening. Alles of niets-uitspraken zoals die van Neuenschwander zijn bedoeld om bezwaren te overwinnen in plaats van hun legitimiteit te erkennen.

In zijn FAQ stelt Apple dat het bedrijf niet zal ingaan op eisen om andere dan CSAM-afbeeldingen in de database op te nemen en dat het systeem is ontworpen om te voorkomen dat andere dan CSAM-afbeeldingen in het systeem kunnen worden ingevoerd.

Q: Waarom maken voorstanders van burgerrechten en privacy zich zorgen om dit systeem?

A: Apple heeft dit systeem om foto's van gebruikers met behulp van geavanceerde technologieën te scannen gecreëerd om de privacy van onschuldigen te beschermen, maar dan nog scant Apple foto's van gebruikers zonder toestemming (en de handeling om iOS 15 te installeren telt niet als daadwerkelijke toestemming).

Het is prijzenswaardig om mensen die bekende CSAM bezitten of distribueren te vinden en te vervolgen. Maar Apple zal ongetwijfeld enorme druk van overheden gaan voelen om meer zaken op het apparaat te gaan scannen. Dit is een oprechte zorg, want Apple is door onderdrukkende regimes al gedwongen geweest om zijn privacy-standpunt af te zwakken, en zelfs de Amerikaanse opsporingsdiensten blijven om een achterdeurtje in de iPhones vragen. Apples FAQ behandelt deze vraag specifiek:

We hebben al eerder te maken gehad met eisen om door overheden opgelegde veranderingen te maken die de privacy van gebruikers zouden verzwakken en we hebben steeds standvastig geweigerd. Wij zullen deze verzoeken ook in de toekomst blijven weigeren. Wij zijn hier heel duidelijk in: deze technologie is beperkt tot het detecteren van CSAM in iCloud en we zullen niet toegeven aan enig overheidsverzoek om dit uit te breiden.

Aan de andere kant kan dit gerichte scannen de druk van opsporingsdiensten en wetgevers verminderen om volledige achterdeurtjes in de versleuteling te maken. We weten niet hoeveel er achter de schermen met de Amerikaanse autoriteiten is onderhandeld om tot deze oplossing te komen, en er worden in Apples materiaal geen overheidsbronnen geciteerd, alleen voormalige bronnen zoals de voormalig U.S. Attorney General Eric Holder. Apple heeft de deur naar nieuwe mogelijkheden opengezet, en niemand weet hoe dit op de lange duur zal uitpakken.

Veiligheidsonderzoeker Matthew Green, die zich vaak uitermate kritisch uit over Apples gebrek aan transparantie en auditing van buitenaf van zijn versleutelingstechnologie zei tegen de New York Times:

Ze hebben aan de hele wereld privacy lopen verkopen waardoor mensen hun apparaten vertrouwen. Maar nu capituleren ze in feite voor de ergst mogelijke eisen van iedere overheid. ik zie niet hoe ze van nu af aan nog nee kunnen zeggen.

Afbeelding scannen in Berichten

Q: Hoe gaat Apple ouderlijk toezicht toepassen op kinderen die afbeeldingen met en seksuele lading versturen of ontvangen?

A: Apple zegt dat het op alle platformen in Berichten een functie om “veilig te communiceren” gaat bouwen. Die zal alleen beschikbaar zijn voor kinderen onder de 18 die onderdeel zijn van een Delen met gezin-groep. (We vragen ons af of Apple de naam van de functie Delen met gezin gaat aanpassen, omdat ze het in hun aankondiging hebben over “accounts die in iCloud staan ingesteld als gezinnen”.) Als deze functie is ingeschakeld, zullen alle binnenkomende en uitgaande afbeeldingen op alle apparaten gekoppeld aan het account van een kind in Delen met gezin op de apparaten zelf worden gescand.

Apple zegt dat het geen toegang heeft tot de afbeeldingen en dat machinaal leren-systemen potentieel seksueel expliciete afbeeldingen zullen identificeren. Merk op dat dit een geheel ander systeem is dan de CSAM-detectie. Het is ontworpen om willekeurige afbeeldingen te identificeren, niet om ze te vergelijken met de CSAM-database.

Q: Wat gebeurt er als er een “gevoelige afbeelding” wordt ontvangen?

A: Berichten vervaagt de binnenkomende afbeelding. Het kind krijgt een waarschuwingsscherm en een waarschuwing onder de afbeelding te zien: “Dit is mogelijk gevoelig. Bekijk foto…” Als je daarop tikt, verschijnt er en scherm met uitleg over het hele beeld met als kop, “Dit kan gevoelig zijn om te bekijken. Weet je het zeker?” Het kind moet dan op "Ik weet het zeker" tikken om verder te gaan.

Voor kinderen onder de 13 kunnen ouders instellen dat de apparaten van hun kinderen hen waarschuwen als kinderen op die koppeling tikken. In dat geval krijgt het kind de melding dat de ouders worden verwittigd. Ze moeten dan op "Bekijk foto" tikken om verder te gaan. Als ze op “Bekijk foto niet” tikken, worden ouders niet verwittigd, ongeacht wat er is ingesteld.

V: Wat gebeurt er als kinderen 'gevoelige afbeeldingen' proberen te versturen?

A: Op een vergelijkbare manier waarschuwt Berichten hen in het geval van een poging om dergelijke afbeeldingen te versturen, en als ze onder de 13 zijn (en deze optie staat aan) komt er ook een melding dat hun ouders zullen worden ingelicht. Als ze de afbeeldingen niet versturen, gebeurt dat laatste niet.

Siri en Zoeken

V: Hoe breidt Apple deze bescherming uit naar Siri en zoekopdrachten?

A: Net zoals informatie over bronnen voor diegenen die zelfmoordgedachten hebben, of wetenschap hebben van mensen in die gemoedstoestand, wordt toegevoegd aan relevante nieuwsberichten en wordt aangeboden door stemassistenten, voegt Apple CSAM-herkenning ook aan Siri en zoekopdrachten toe. Het bedrijf zegt dat er twee soorten interventies aangeboden worden:

- Als iemand vraagt naar CSAM of een melding maakt van kindermisbruik, krijgt die persoon informatie over 'waar en hoe een melding gemaakt kan worden'.

- Als iemand vraagt om of zoekt naar materiaal met kindermisbruik krijgt die persoon volgens Apple 'uitleg dat interesse in dit onderwerp schade toebrengt en problematisch is, en materiaal aangeboden zodat mensen met dit probleem geholpen kunnen worden'.

Heeft Apple de doos van Pandora geopend?

Apple staat voor een enorme uitdaging om deze technologie alleen voor deze gevallen toe te passen. Niet alleen zijn er geen technische obstakels om de CSAM-technologie ook voor andere content uit te rollen, maar primitieve versies van de technologie worden gebruikt door veel organisaties en zijn onderdeel van veel technologiestandaarden. Er is bijvoorbeeld een technologie onder de naam Data Loss Prevention die ook hashcodes van tekst, afbeeldingen en bestanden scant bij bedrijven om bepaald materiaal op te sporen.

Als Apple de rug rechthoudt en alleen op CSAM scant om kindermisbruik op te sporen, zal deze stap waarschijnlijk een voetnoot zijn in de geschiedenis van het bedrijf. Maar Apple zal enorme druk ondervinden van regeringen waar ook ter wereld om deze technologie ook voor andere content te gebruiken. En een aantal van die regeringen zullen het niet zo nauw nemen met mensenrechten, en Apple heeft al aanpassingen gedaan aan de privacytechniek van producten van het bedrijf om in die landen zaken te kunnen doen. Als Apple ooit buigt voor dergelijke eisen, zal deze aankondiging het begin zijn van het eind van Apple als privacykampioen.

Wij leggen uit wat je weten moet over Apple-technologie. |

Vorige aflevering | TidBITS Nederlands | Volgende aflevering